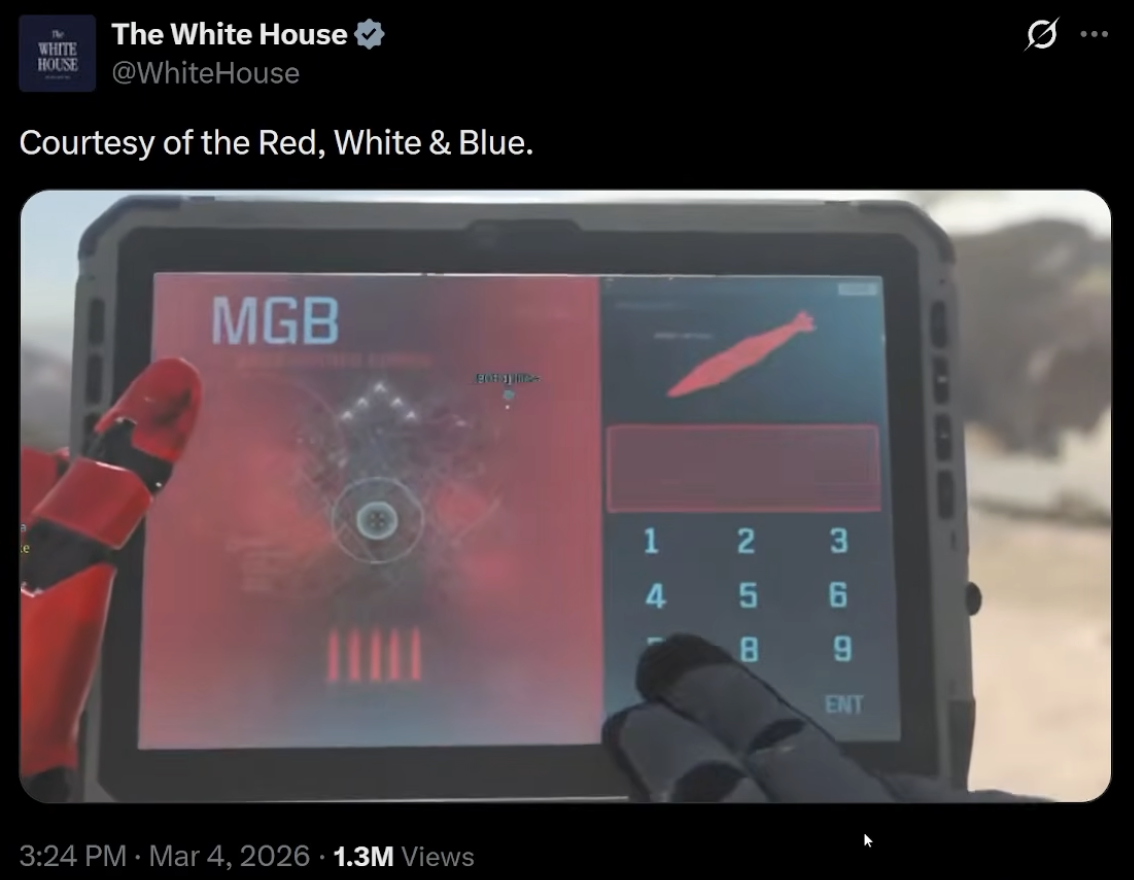

Nelle ultime settimane la Casa Bianca di Trump ha pubblicato una serie di contenuti piuttosto illuminanti. Dal video razzista sugli Obama alle immagini generate dall'IA per alimentare una disputa di hockey con il Canada, fino al tentativo di vendere la loro guerra contro l'Iran usando grafica da videogioco mescolata a vere riprese di combattimento, l'amministrazione ci sta offrendo una masterclass nell'arte di seminare discordia.

E non lo fanno cercando di finire nei notiziari. Nessuno di questi video è stato pensato per i giornalisti — se non per far sì che parlino dell'esistenza stessa di quei video. Tutto è progettato per i feed dei social, dove il contenuto medio riceve circa 1,7 secondi di attenzione. 1,7 secondi non bastano per informare. Ma bastano per provocare. Bastano per farti sentire qualcosa prima ancora che tu abbia il tempo di chiederti se sia reale.

E questa è la verità: abbiamo cominciato a scorrere così perché le piattaforme sono state progettate apposta per questo.

Prima lentamente, poi tutto in una volta

C'è una distinzione utile che oggi tendiamo a dimenticare: il social networking e i social media non sono la stessa cosa. Ed è nel passaggio dall'uno all'altro che originano gran parte dei problemi che abbiamo oggi.

Il social networking era attivo. Condividevi cose con persone che conoscevi. Loro condividevano qualcosa; magari ti interessava, magari no. In ogni caso era qualcosa di comunitario, conversazionale.

I social media invece sono passivi. Si scrolla. Un algoritmo decide cosa vedi, non in base a chi conosci o a ciò che hai chiesto, ma a quello che ti terrà lì il più a lungo possibile.

Questo cambiamento non è avvenuto perché gli utenti lo chiedevano. È avvenuto perché il loro modello di business è il tempo — il tuo tempo, nello specifico, e quanto riescono a catturarne.

Quando i tuoi ricavi arrivano dalla pubblicità, tre cose contano più di tutto: quanti utenti hai, quanto tempo restano e quanti dati puoi raccogliere per profilarli. La felicità degli utenti non compare da nessuna parte in quell'equazione. Né la verità.

Lo sapevano

Nel 2017 Facebook fece una modifica discreta al suo algoritmo. Le reazioni emoji — cuore, sorpresa, tristezza, rabbia — vennero pesate cinque volte più di un semplice mi piace. Il ragionamento era semplice: le reazioni emotive forti generano più engagement, e più engagement significa più tempo sulla piattaforma.

I loro stessi ricercatori segnalarono il problema quasi subito. Già nel 2019 i data scientist interni di Facebook lo avevano confermato nero su bianco: i post che ricevevano reazioni di rabbia avevano una probabilità sproporzionata di contenere disinformazione, tossicità e contenuti di bassa qualità. La loro stessa piattaforma stava amplificando sistematicamente i suoi contenuti peggiori — e lo sapevano.

Eppure hanno continuato lo stesso.

Quando nel 2021 trapelarono i Facebook Files, Meta fece qualche aggiustamento. Ridusse il peso di quelle reazioni. Pubblicò dichiarazioni sui team dedicati all'integrità. Ma i loro stessi dati, quando alla fine azzerarono completamente l'emoji della rabbia, raccontarono la vera storia: la disinformazione diminuì, i contenuti dannosi diminuirono — e l'engagement complessivo degli utenti non cambiò praticamente per nulla.

E ora hanno smesso di fingere

Gennaio 2025. Meta annuncia la fine del suo programma indipendente di fact-checking — quello che aveva mantenuto per quasi un decennio. Più di 70 organizzazioni di verifica dei fatti firmano una lettera aperta per condannare la decisione. L'ammissione pubblica di Meta sulle conseguenze? Che i contenuti dannosi inevitablmente aumenteranno.

Lo hanno detto. Sapendolo. E lo hanno fatto comunque.

(Curiosità: Sunslider è nata nel gennaio 2025, in gran parte per il disgusto che mi ha provocato tutto questo, e altre posizioni simili prese da Meta e da Mark Zuckerberg dopo la rielezione di Trump — come la dichiarazione di Zuckerberg secondo cui le aziende avrebbero bisogno di più "energia maschile". Scusatemi un attimo: devo andare a raccogliere i miei occhi che mi sono rotolati via dalla testa.)

Con cosa hanno sostituito quei fact-checker? Con le Community Notes — che tradotto significa "fate lo facciano gli utenti". Sulla carta sembra democratico. Non funziona. Twitter lo ha già dimostrato: uno studio su un milione di Community Notes durante le elezioni americane del 2024 ha rilevato che il 74% delle correzioni accurate non è mai stato visto dagli utenti. Torniamo a quei 1,7 secondi: i social media sono progettati per amplificare i contenuti emotivi e seppellire le correzioni.

Quindi la loro soluzione ai problemi degli algoritmi viene sconfitta dagli algoritmi stessi. Divertente come funziona.

Il vero insulto

Meta ha generato 160 miliardi di dollari di ricavi pubblicitari nel 2024. Niente male — ma nel 2025 sono diventati 195 miliardi. Quasi mezzo trilione di dollari in due anni, grazie a un modello di business basato su una cosa sola: tenerti sulla piattaforma il più a lungo possibile, farti sentire il più possibile, farti cliccare il più possibile. Il contenuto emotivo — vero o inventato — serve molto meglio a questo scopo di un contenuto pacato.

Ma stare incollati al telefono a fare doomscrolling è davvero il tuo obiettivo?

Domanda retorica, ovviamente. Ma pensiamo anche a cosa si sta introducendo in questo ambiente: l'ondata di contenuti generati dall'IA. Quello che sei mesi fa iniziava appena a intravedersi è ora qui in piena forza: immagini generate, citazioni fabbricate, video sintetici, interi account che esistono solo per provocare una reazione e venderti qualcosa di rimorchio — un'opinione politica, un paio di jeans, una versione della realtà. La struttura di incentivi che già spingeva verso l'indignazione e la disinformazione ha ora alle spalle una macchina di produzione di contenuti su scala industriale.

E ancora una volta, la risposta di questi giganti è farne un problema tuo.

Tu — non pagato, non formato, a scorrere centinaia di post al giorno — sei ora apparentemente responsabile di verificare il feed che aziende da trilioni di dollari creano per te. Non so voi, ma io non ho né il tempo né la voglia di analizzare ogni contenuto che vedo per capire se sia reale. Non è una richiesta ragionevole da fare a nessuno.

Eppure chiedere cose irragionevoli agli utenti, mentre i ricavi pubblicitari continuano a crescere, è perfettamente coerente con il modo in cui queste piattaforme hanno sempre funzionato.

Torniamo a quel video della Casa Bianca

Funziona. Non come giornalismo. Non come realtà. Ma come contenuto per i social media funziona alla perfezione — su tutti gli spettri politici. Ti fa sentire qualcosa prima che tu abbia il tempo di pensare. Viene condiviso prima di essere verificato. Vive in un feed progettato apposta per far prosperare esattamente questo tipo di contenuto.

Niente di tutto questo cambierà finché non cambierà il modello di business. Le piattaforme che ottimizzano per l'engagement scopriranno sempre che rabbia, indignazione e paura funzionano meglio dell'accuratezza. Non è un bug. È il risultato inevitabile del sistema.

Da Sunslider siamo partiti da un posto diverso. Niente pubblicità significa nessun incentivo a massimizzare il tuo tempo nell'app. Nessun feed algoritmico significa nessun sistema che impari a premere i tuoi tasti emotivi. Questo non risolve il problema più ampio — non siamo così ingenui. Ma è almeno un tentativo onesto di costruire qualcosa che non lavori contro di te.