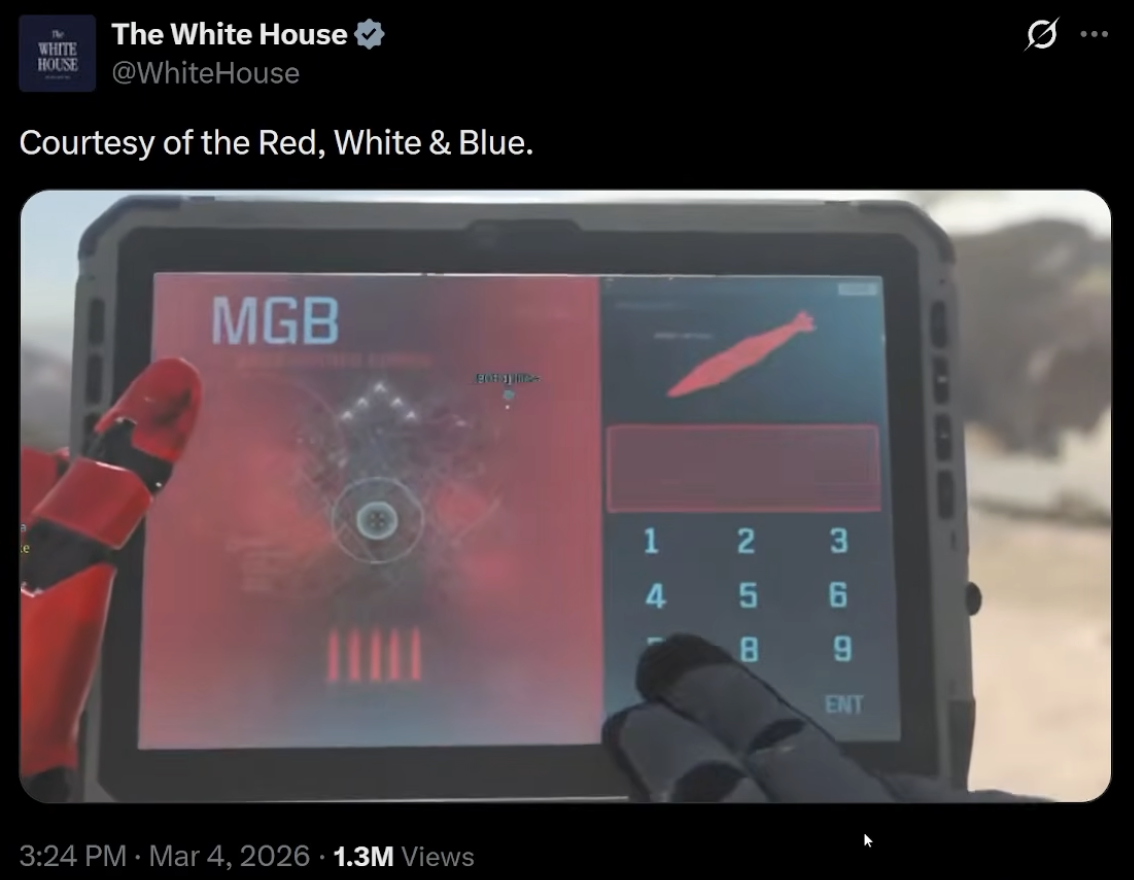

Durante las últimas semanas, la Casa Blanca de Trump ha estado publicando ciertos contenidos de lo más ilustrativos. Desde el vídeo racista sobre los Obama hasta las imágenes generadas por IA para caldear una disputa de hockey con Canadá, pasando por el intento de vender su guerra contra Irán con gráficos de videojuego mezclados con imágenes reales de combate, la administración nos está ofreciendo una clase magistral en el arte de sembrar cizaña.

Y no lo hacen intentando colocarlo en los informativos. Ninguno de estos vídeos fue hecho para periodistas, salvo para que reporten la mera existencia de los mismos. Todo está pensado para los feeds de las redes sociales, donde el contenido medio recibe unos 1,7 segundos de atención. 1,7 segundos no bastan para informar. Pero sí bastan para provocar. Bastan para hacerte sentir algo antes de que puedas plantearte si es real.

Y esta es la verdad: empezamos a hacer scroll así porque las plataformas fueron diseñadas precisamente para eso.

Poco a poco, y de golpe

Hay una distinción útil que hoy tendemos a olvidar: las redes sociales de conexión y los medios sociales no son lo mismo. Y es en el paso de uno a otro donde empiezan la mayoría de nuestros problemas actuales.

Las redes de conexión eran activas. Compartías cosas con gente que conocías. Ellos compartían algo; quizá te interesaba, quizá no. Pero en cualquier caso era algo comunitario, conversacional.

Los medios sociales, en cambio, son pasivos. Haces scroll. Un algoritmo decide lo que ves, no en función de a quién conoces o de lo que has pedido, sino de lo que te mantendrá allí el mayor tiempo posible.

Ese cambio no ocurrió porque los usuarios lo pidieran. Ocurrió porque su modelo de negocio es el tiempo — tu tiempo, concretamente, y cuánto de él pueden capturar.

Cuando tus ingresos vienen de la publicidad, tres cosas importan por encima de todo: cuántos usuarios tienes, cuánto tiempo se quedan y cuántos datos puedes recopilar para segmentarlos. La felicidad del usuario no aparece en ningún lugar de esa ecuación. La verdad tampoco.

Lo sabían

En 2017, Facebook hizo un cambio discreto en su algoritmo. Las reacciones con emoji — me encanta, sorpresa, tristeza, enfado — pasaron a tener cinco veces más peso que un simple me gusta. El razonamiento era sencillo: las reacciones emocionales fuertes generan más engagement, y más engagement significa más tiempo en la plataforma.

Sus propios investigadores señalaron el problema casi de inmediato. Para 2019, los científicos de datos internos de Facebook lo habían confirmado por escrito: las publicaciones que recibían reacciones de enfado tenían una probabilidad desproporcionada de contener desinformación, toxicidad y contenido de baja calidad. Su propia plataforma estaba amplificando sistemáticamente sus peores contenidos — y lo sabían.

Aun así, lo dejaron tal cual.

Cuando se filtraron los Facebook Files en 2021, Meta hizo algunos ajustes. Redujo la ponderación. Publicó comunicados sobre sus equipos de integridad. Pero sus propios datos, cuando finalmente eliminaron por completo el emoji de enfado, contaron la historia real: la desinformación bajó, los contenidos dañinos bajaron — y el nivel general de engagement de los usuarios no cambió en absoluto.

Y ahora han dejado de fingir

Enero de 2025. Meta anuncia el fin de su programa independiente de verificación de datos — el que había mantenido durante casi una década. Más de 70 organizaciones de fact-checking firman una carta abierta condenando la decisión. ¿El propio reconocimiento público de Meta sobre las consecuencias? Que los contenidos dañinos inevitablemente aumentarán.

Eso dijeron. Sabiéndolo. Y aun así lo hicieron.

(Dato curioso: Sunslider nació en enero de 2025, en gran parte por el asco que me provocó todo esto, y otras posturas similares que Meta y Mark Zuckerberg adoptaron tras la reelección de Trump, como la declaración de Zuckerberg de que las empresas necesitan más "energía masculina". Perdonadme un momento: tengo que ir a recoger mis ojos, que acaban de rodar cuesta abajo fuera de mi cabeza.)

¿Con qué sustituyeron a esos verificadores de hechos? Con las Community Notes — que viene a ser "que lo hagan los usuarios". Sobre el papel suena democrático. En la práctica no funciona. Twitter ya lo demostró: un estudio sobre un millón de Community Notes durante las elecciones estadounidenses de 2024 encontró que el 74 % de las correcciones acertadas nunca fueron vistas por los usuarios. Volvemos a esos 1,7 segundos: los medios sociales están diseñados para amplificar el contenido emocional y enterrar las correcciones.

O sea, que su solución para sus algoritmos queda derrotada por sus propios algoritmos. Curioso cómo funciona eso.

El verdadero insulto

Meta generó 160.000 millones de dólares en ingresos publicitarios en 2024. Nada mal — pero en 2025 fueron 195.000 millones. Casi medio billón de dólares en dos años, gracias a un modelo de negocio basado en mantenerte el mayor tiempo posible en la plataforma, haciéndote sentir lo máximo posible, haciendo que hagas clic lo máximo posible. El contenido emocional — verdadero o inventado — sirve mucho mejor a ese objetivo que el contenido tranquilo.

Pero ¿es estar pegado al móvil haciendo doomscrolling tu objetivo?

Pregunta retórica, obviamente. Pero pensemos también en lo que se está introduciendo ahora mismo en este entorno: la avalancha de contenido generado por IA. Lo que hace seis meses empezaba a asomar ya está aquí con toda su fuerza: imágenes generadas, citas fabricadas, vídeos sintéticos, cuentas enteras que existen únicamente para provocar una reacción y venderte algo a continuación — una opinión política, unos vaqueros, una versión de la realidad. La estructura de incentivos que ya empujaba hacia la indignación y la desinformación cuenta ahora con una máquina de producción de contenido a escala industrial.

Y, una vez más, la respuesta de estos gigantes es convertirlo en tu problema.

Tú — sin cobrar, sin formación, haciendo scroll por cientos de publicaciones al día — eres ahora aparentemente responsable de verificar el feed que empresas valoradas en billones de dólares crean para ti. No sé vosotros, pero yo no tengo ni el tiempo ni las ganas de analizar cada contenido que veo para determinar si es real. No es algo razonable pedírselo a nadie.

Pero resulta que pedir cosas irrazonables a los usuarios, mientras los ingresos publicitarios no dejan de crecer, encaja perfectamente con la forma en que estas plataformas siempre han funcionado.

Lo que nos devuelve a aquel vídeo de la Casa Blanca

Funciona. No como periodismo. No como realidad. Pero como contenido para redes sociales, funciona perfectamente — y en todos los lados del espectro político. Hace que sientas algo antes de que tengas tiempo de pensar. Se comparte antes de que se verifique. Vive en un feed que fue diseñado específicamente para que exactamente este tipo de contenido prospere.

Nada de esto va a cambiar hasta que cambie el modelo de negocio. Las plataformas que optimizan para el engagement siempre acabarán descubriendo que la rabia, la indignación y el miedo rinden mejor que la precisión. No es un fallo. Es el resultado inevitable del sistema.

En Sunslider partimos de un lugar diferente. Sin publicidad significa que no existe ningún incentivo para maximizar tu tiempo en la app. Sin feed algorítmico significa que no hay ningún sistema aprendiendo a pulsar tus botones emocionales. Eso no resuelve el problema más amplio — no somos tan ingenuos. Pero es al menos un intento honesto de construir algo que no trabaje en tu contra.