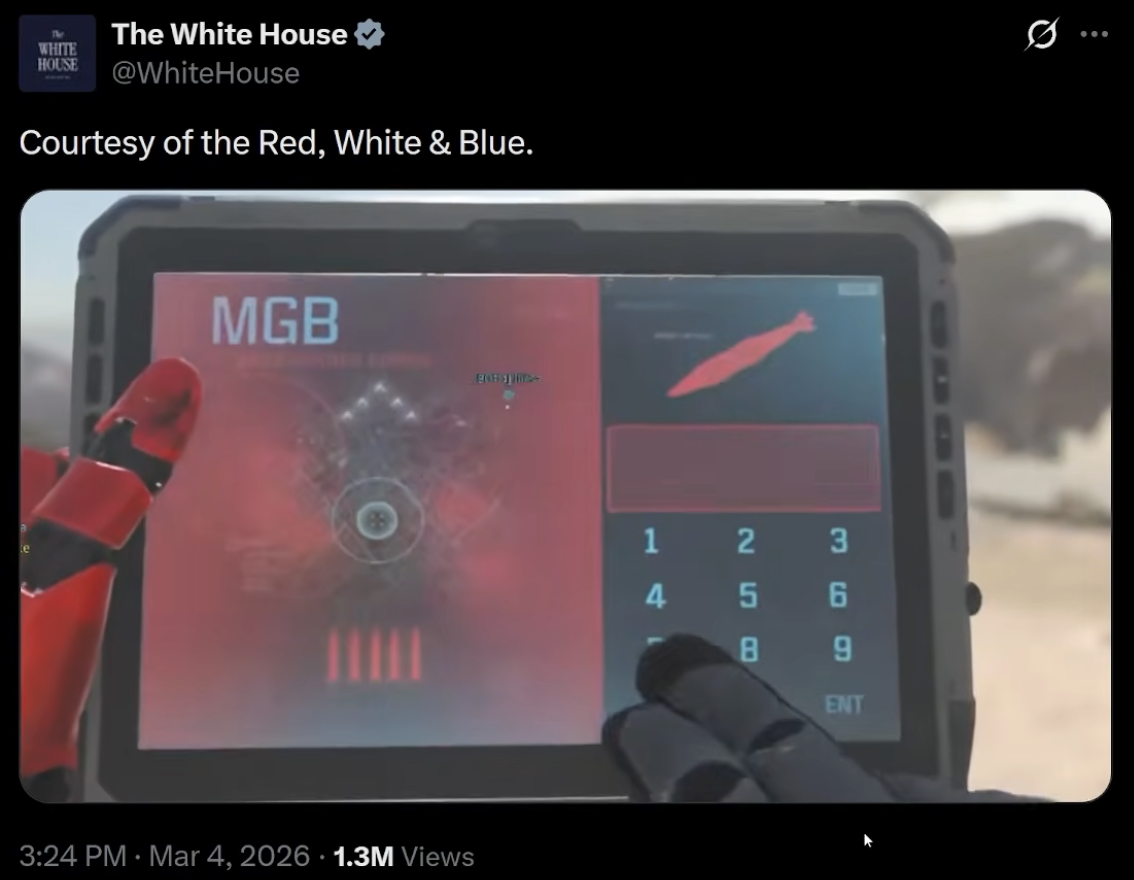

Au cours des dernières semaines, la Maison-Blanche de Trump a publié quelques petites perles. De la vidéo raciste sur les Obama aux images générées par IA pour alimenter une querelle de hockey avec le Canada, en passant par une tentative de vendre leur guerre contre l'Iran à coups de graphismes de jeux vidéo mélangés à de vraies images de combats, l'administration nous offre une masterclass dans l'art de semer la discorde.

Et ils ne le font pas pour passer au journal télévisé. Aucun de ces contenus n'a été conçu pour les journalistes — si ce n'est pour qu'ils rapportent l'existence même de ces vidéos. Tout est fait pour les fils d'actualité, là où un contenu moyen capte environ 1,7 seconde d'attention. 1,7 seconde, ce n'est pas assez pour informer. Mais c'est suffisant pour provoquer. Suffisant pour vous faire ressentir quelque chose avant même d'avoir le temps de vous demander si c'est réel.

Et voilà la vérité : si on fait défiler comme ça, c'est parce que les plateformes ont été construites exprès pour ça.

Lentement d'abord, puis d'un seul coup

Il y a une distinction utile qu'on a tendance à oublier aujourd'hui : le réseau social et les médias sociaux, ce n'est pas la même chose. Et c'est dans ce glissement de l'un à l'autre que la plupart de nos problèmes actuels prennent racine.

Le réseau social, c'était actif. On partageait des choses avec des gens qu'on connaissait. Eux partageaient quelque chose, peut-être que ça vous intéressait, peut-être pas. Quoi qu'il en soit, c'était communautaire, conversationnel.

Les médias sociaux, c'est passif. On fait défiler. Un algorithme décide ce qu'on voit — non pas en fonction de qui on connaît ou de ce qu'on a demandé, mais de ce qui va nous garder là le plus longtemps.

Ce basculement n'est pas arrivé parce que les utilisateurs le réclamaient. Il est arrivé parce que leur modèle économique, c'est le temps — votre temps, précisément, et la quantité qu'ils peuvent en capturer.

Quand vos revenus viennent de la publicité, trois choses comptent par-dessus tout : le nombre d'utilisateurs, la durée de leur présence, et la quantité de données qu'on peut collecter pour les cibler. Le bonheur des utilisateurs n'apparaît nulle part dans cette équation. La vérité non plus.

Ils le savaient

En 2017, Facebook a modifié son algorithme. Les réactions emoji — amour, wow, triste, colère — ont été pondérées cinq fois plus qu'un simple like. Le raisonnement était limpide : les réactions émotionnelles fortes généraient plus d'engagement, et plus d'engagement signifiait plus de temps passé sur la plateforme.

Leurs propres chercheurs ont presque immédiatement soulevé le problème. Dès 2019, les data scientists internes de Facebook l'avaient confirmé noir sur blanc : les publications qui recevaient des réactions de colère étaient de manière disproportionnée susceptibles de contenir de la désinformation, des contenus toxiques et des informations de mauvaise qualité. Leur propre plateforme amplifiait systématiquement ses pires contenus, et ils le savaient.

Ils ont pourtant laissé faire.

Quand les Facebook Files ont fuité en 2021, Meta a fait des ajustements. Réduit la pondération. Publié des déclarations sur ses équipes dédiées à l'intégrité. Mais leurs propres données, quand ils ont finalement supprimé entièrement l'emoji colère, ont dit la vérité : la désinformation a baissé, les contenus nuisibles ont baissé — et oh, l'engagement global des utilisateurs n'a absolument pas bougé.

Et maintenant, ils ont arrêté de faire semblant

Janvier 2025. Meta annonce la fin de son programme indépendant de vérification des faits — celui qu'il avait maintenu pendant près d'une décennie. Plus de 70 organisations de fact-checking signent une lettre ouverte pour condamner la décision. La reconnaissance publique de Meta quant aux conséquences ? Que les contenus nuisibles vont inévitablement augmenter.

Ils l'ont dit. En le sachant. Et ils l'ont fait quand même.

(Petite précision : Sunslider est né en janvier 2025, en grande partie à cause de mon dégoût face à ça, et à d'autres prises de position similaires de Meta et de Mark Zuckerberg dans la foulée de la réélection de Trump — comme sa déclaration que les entreprises ont besoin de plus d'"énergie masculine". Excusez-moi un instant, il faut que j'aille ramasser mes yeux qui viennent de rouler jusqu'au bout du couloir.)

Par quoi ont-ils remplacé ces fact-checkers ? Les Community Notes — autrement dit, les utilisateurs qui font le travail à leur place. Ça sonne démocratique. Ça ne fonctionne pas. Twitter l'a déjà montré : une étude portant sur un million de Community Notes lors de l'élection américaine de 2024 a révélé que 74 % des corrections exactes n'ont jamais été vues par les utilisateurs. On en revient à ces 1,7 secondes : les médias sociaux sont conçus pour amplifier les contenus émotionnels et enterrer les corrections.

Leur remède à leurs algorithmes est donc battu par leurs algorithmes. Amusant, non ?

La vraie insulte

Meta a généré 160 milliards de dollars de revenus publicitaires en 2024. Pas mal — mais en 2025, c'était 195 milliards. Presque un demi-billion de dollars en deux ans, grâce à un modèle économique fondé sur une seule chose : vous garder le plus longtemps possible sur la plateforme, à ressentir le plus possible, à cliquer le plus possible. Le contenu émotionnel — vrai ou inventé — sert mieux leurs objectifs qu'un contenu calme.

Mais rester collé à votre téléphone à faire du doomscrolling, c'est vraiment votre objectif ?

Question rhétorique, évidemment. Mais réfléchissons aussi à ce qui est en train d'arriver dans cet environnement : le déluge de contenus générés par IA. Ce qui se profilait il y a six mois est désormais là en force : images générées, citations fabriquées, vidéos synthétiques, comptes entiers qui n'existent que pour provoquer une réaction et vous vendre quelque chose dans la foulée. Une opinion politique. Une paire de jeans. Une version de la réalité. La structure d'incitation qui poussait déjà vers l'indignation et la désinformation dispose maintenant d'une machine à contenu à l'échelle industrielle.

Et là encore, la réponse de ces géants, c'est d'en faire votre problème.

Vous — non rémunéré, non formé, en train de faire défiler des centaines de publications par jour — êtes désormais apparemment responsable de vérifier le fil d'actualité que des entreprises à mille milliards de dollars créent pour vous. Je ne sais pas pour vous, mais moi je n'ai ni le temps ni l'envie d'analyser chaque contenu que je vois pour déterminer s'il est réel. Ce n'est pas une chose raisonnable à demander à qui que ce soit.

Mais il s'avère que demander des choses déraisonnables aux utilisateurs, pendant que les revenus publicitaires continuent de grimper, est parfaitement cohérent avec la façon dont ces plateformes ont toujours fonctionné.

Alors, cette vidéo de la Maison-Blanche

Ça marche. Pas comme du journalisme. Pas comme la réalité. Mais comme contenu pour les médias sociaux, ça marche parfaitement — et dans tous les camps politiques. Ça fait ressentir quelque chose avant qu'on ait le temps de réfléchir. Ça se partage avant d'être vérifié. Ça vit dans un fil qui a été spécifiquement conçu pour laisser exactement ce type de contenu prospérer.

Rien de tout ça ne changera tant que le modèle économique ne changera pas. Des plateformes qui optimisent pour l'engagement trouveront toujours que la colère, l'indignation et la peur surpassent la précision. Ce n'est pas un bug. C'est la conséquence logique du système.

Chez Sunslider, on est partis d'un endroit différent. Pas de publicité signifie aucune incitation à maximiser votre temps dans l'application. Pas de fil algorithmique signifie aucun système qui apprend à appuyer sur vos boutons émotionnels. Ça ne résout pas le problème plus large — on n'est pas naïfs à ce point. Mais c'est au moins une tentative honnête de construire quelque chose qui ne travaille pas contre vous.